AI Hallucination ಅಂದ್ರೆ ಏನು? AI ಯಾಕೆ ಕೆಲವೊಮ್ಮೆ ತಪ್ಪು ಮಾಹಿತಿ ಕೊಡುತ್ತದೆ?

AI systems ತುಂಬಾ smart ಆಗಿವೆ.

Questions ಗೆ fast answers ಕೊಡುತ್ತವೆ, articles ಬರೆಯುತ್ತವೆ, coding ಕೂಡ ಮಾಡುತ್ತವೆ.

ಆದ್ರೆ ಕೆಲವೊಮ್ಮೆ AI confident ಆಗಿ ತಪ್ಪು information ಕೂಡ ಕೊಡುತ್ತದೆ.

ಇದನ್ನೇ AI world ನಲ್ಲಿ “AI Hallucination” ಅಂತ ಕರೀತಾರೆ.

AI Hallucination ಅಂದ್ರೆ ಏನು?

AI hallucination ಅಂದ್ರೆ

AI system correct answer ಗೊತ್ತಿಲ್ಲದಿದ್ದರೂ

ತಾನೇ information create ಮಾಡಿ answer ಕೊಡೋದು.

ಅದು:

- Fake facts generate ಮಾಡಬಹುದು

- Wrong references ಕೊಡಬಹುದು

- Non-existent sources ಹೇಳಬಹುದು

AI ಗೆ ಅದು ತಪ್ಪು ಅನ್ನೋ ಅರಿವು ಇರೋದಿಲ್ಲ.

Simple example

User ಕೇಳಿದ question:

“2022ರಲ್ಲಿ ಯಾವ company first AI phone launch ಮಾಡಿತು?”

Correct answer clear ಇಲ್ಲದಿದ್ದರೆ

AI sometimes imaginary company name create ಮಾಡಬಹುದು.

Answer confident ಆಗಿ ಕಾಣುತ್ತದೆ.

ಆದ್ರೆ fact wrong ಆಗಿರಬಹುದು.

AI ಯಾಕೆ hallucinate ಮಾಡುತ್ತದೆ?

AI models knowledge database ಅಲ್ಲ.

ಅವು pattern prediction systems.

ಅವು:

- Next word predict ಮಾಡುತ್ತವೆ

- Context follow ಮಾಡುತ್ತವೆ

- Most probable answer generate ಮಾಡುತ್ತವೆ

Fact verify ಮಾಡುವ mechanism always strong ಇರೋದಿಲ್ಲ.

Hallucination ಯಾವ situation ನಲ್ಲಿ ಹೆಚ್ಚು ಆಗುತ್ತದೆ?

AI hallucination ಸಾಮಾನ್ಯವಾಗಿ ಈ ಸಂದರ್ಭಗಳಲ್ಲಿ ಕಾಣಿಸುತ್ತದೆ:

Unknown topics

Rare facts

Recent events

Very specific data

Training data ನಲ್ಲಿ clear information ಇಲ್ಲದಿದ್ದರೆ

AI guess ಮಾಡುತ್ತದೆ.

ಇದರಿಂದ ಏನು problem?

Hallucination detect ಮಾಡದೇ ಇದ್ದರೆ:

Wrong information spread ಆಗಬಹುದು

Research errors ಆಗಬಹುದು

Business decisions ತಪ್ಪಾಗಬಹುದು

ಅದಕ್ಕೇ AI answers blindly trust ಮಾಡಬಾರದು.

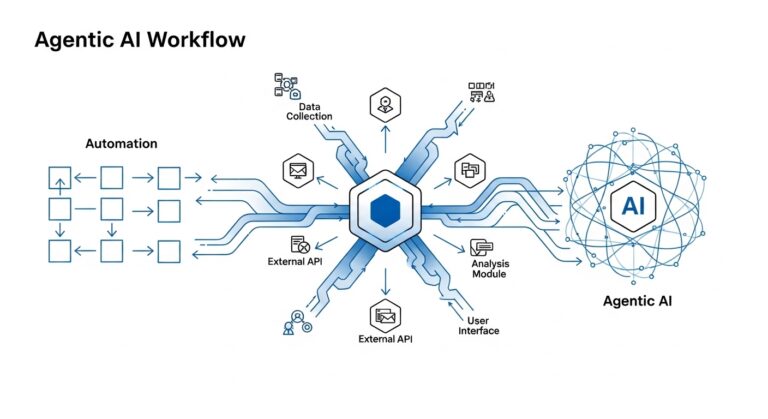

Companies ಇದನ್ನು ಹೇಗೆ reduce ಮಾಡ್ತಿವೆ?

Modern AI systems ನಲ್ಲಿ companies ಈ methods use ಮಾಡ್ತಿವೆ:

Retrieval systems (external knowledge sources)

Fact verification layers

Human feedback training

Tool integration

ಈ methods hallucination rate reduce ಮಾಡುತ್ತವೆ.

Kannada readers ಗೆ takeaway

AI powerful tool.

ಆದ್ರೆ AI = always correct ಅಲ್ಲ.

AI use ಮಾಡುವಾಗ:

- Cross-check information

- Trusted sources verify

- Critical thinking maintain

ಈ approach safe.

AI Kannada Tech ನಲ್ಲಿ ಮುಂದಿನ ದಿನಗಳಲ್ಲಿ

AI reliability ಮತ್ತು trust ಬಗ್ಗೆ ಇನ್ನಷ್ಟು concepts explain ಮಾಡ್ತೇವೆ.